Stable Diffusion – nowy darmowy model generujący obraz na podstawie tekstu

Udostępniony model Stable Diffusion w github.com powstał przy współpracy Stability AI i Runway. O firmie Stability AI już pisaliśmy w związku z wydaniem właśnie przez tą firmę rewelacyjnego generatora DreamStudio Beta Litle.

Stable Diffusion działa na GPU Nvidia z co najmniej 10 GB VRAM i generuje obraz w rozdzielczości 512×512 pikseli w kilka sekund. W moim przypadku na RTX A4000 wygenerowanie jednego obrazu trwało 8 sekund.

Wszystkie informację jak zainstalować i skonfigurować model znajdziecie pod tym linkiem: https://github.com/CompVis/stable-diffusion

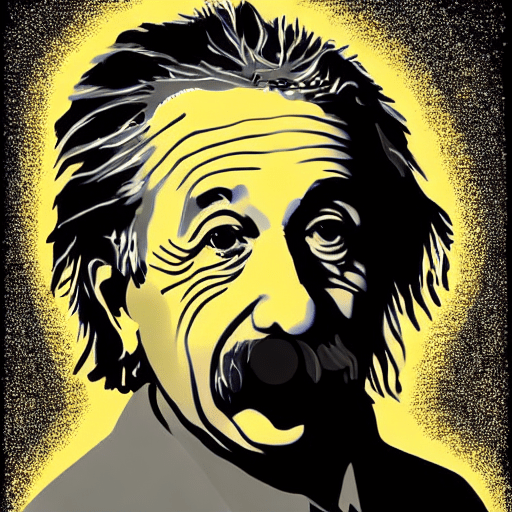

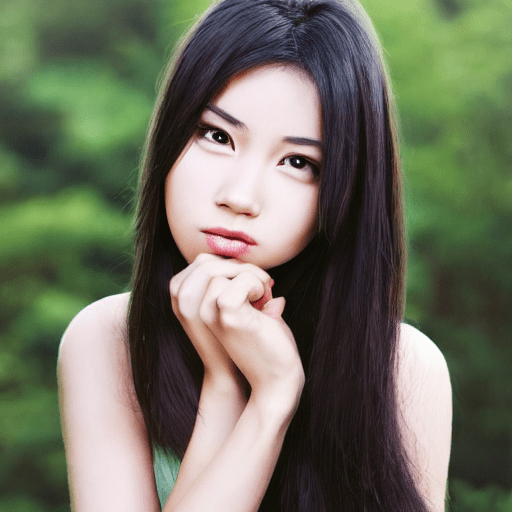

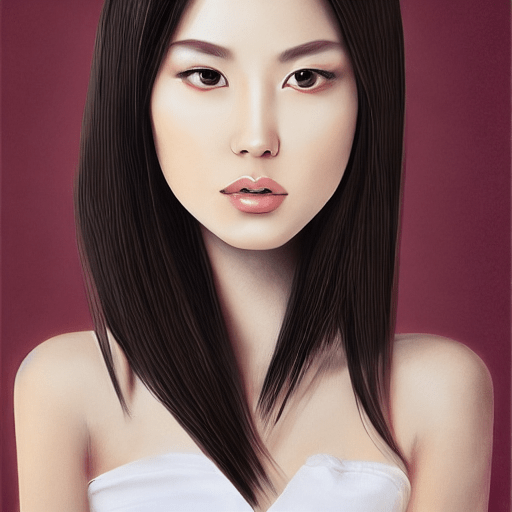

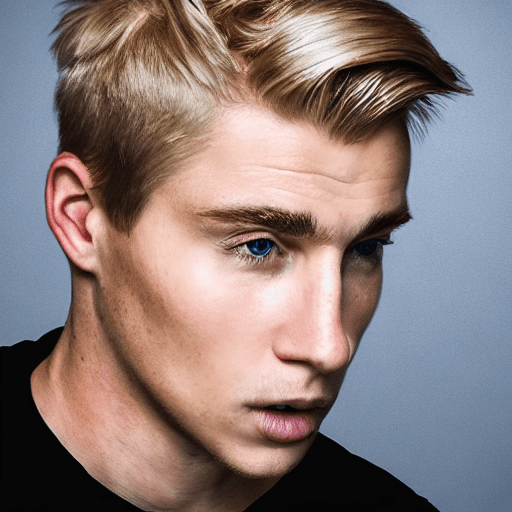

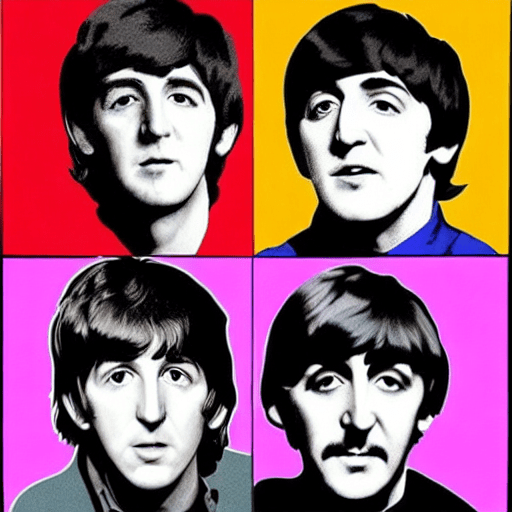

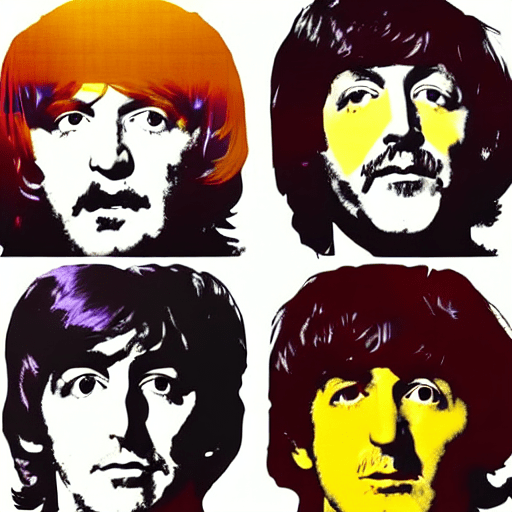

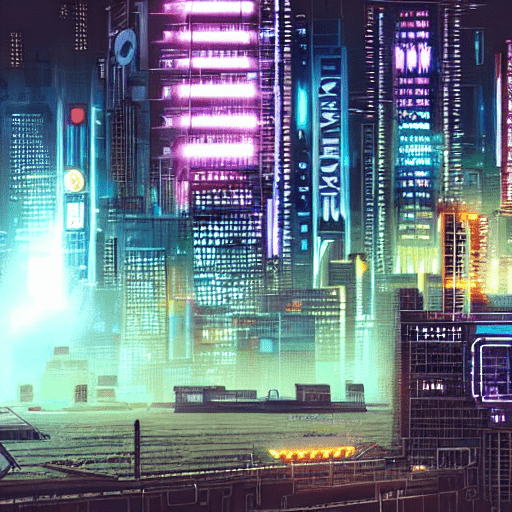

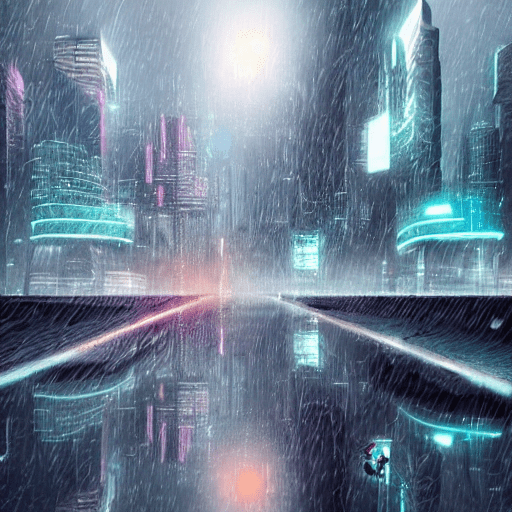

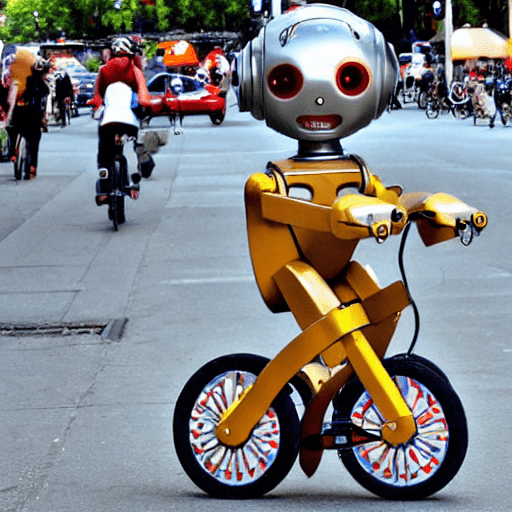

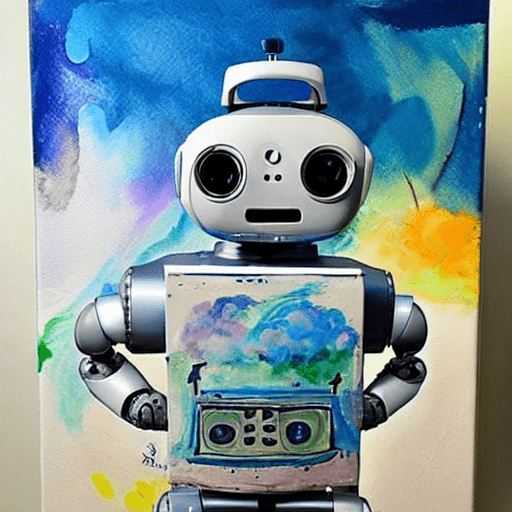

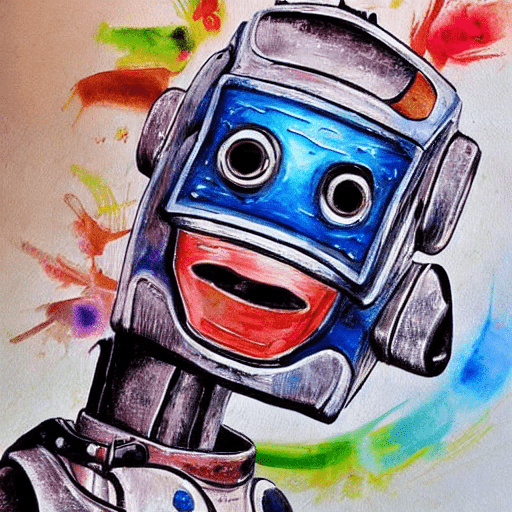

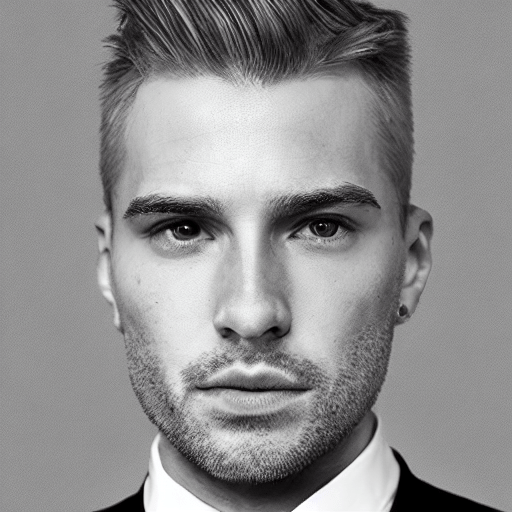

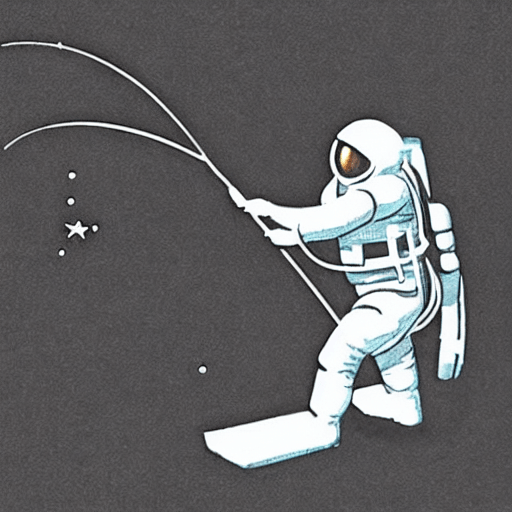

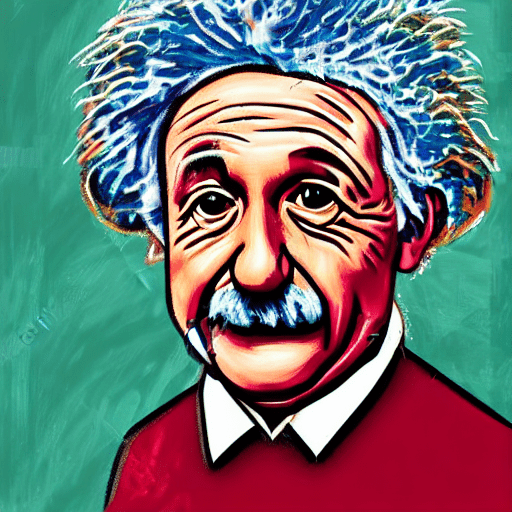

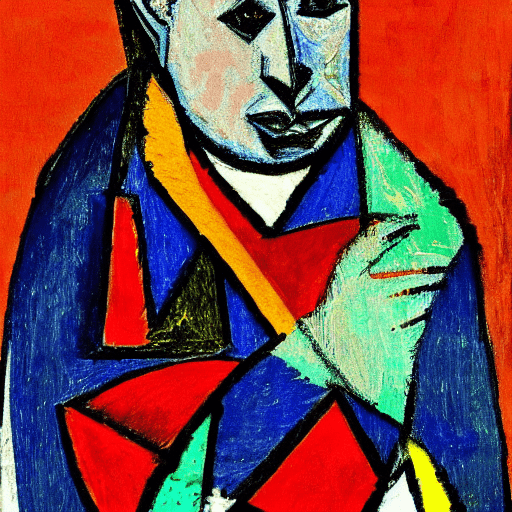

Udostępniony model nie można oczywiście porównywać do DreamStudio Beta Litle jednak na pewno znacznie przewyższa DALL-E Mini pod względem jakości generowanych obrazów. Poniżej /wybrane/ zdjęcia wygenerowane przy pomocy nowego darmowego modelu.

Jak widzicie nowy darmowy model ma spore możliwości jednak raczej nie nadaje się do tworzenia foto-realistycznych zdjęć, ale i tak jestem jego dużym wrażeniem.