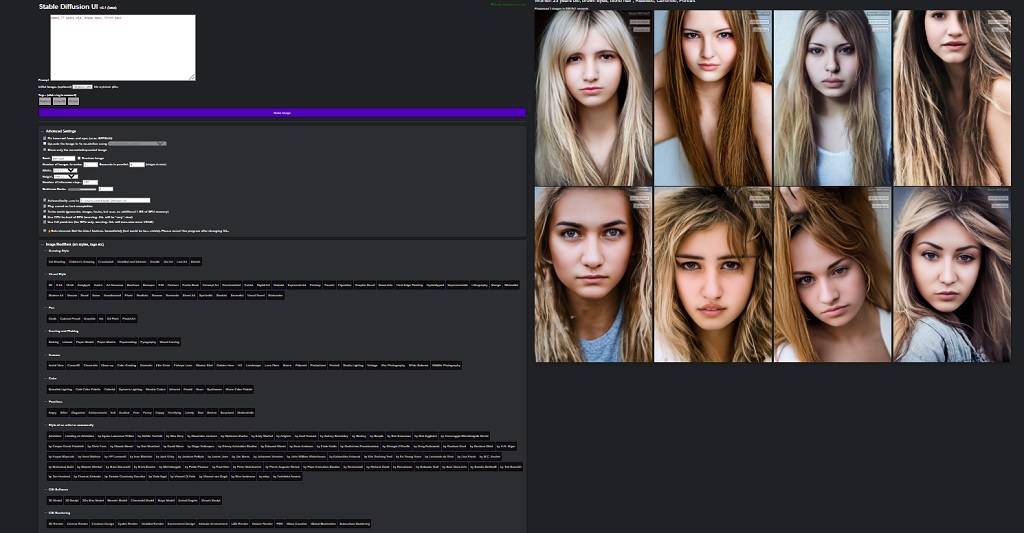

Generowanie fotorealistycznych portretów przy pomocy Stable Diffusion UI v2

Stable Diffusion podbija Internet a jego wersja umożliwiająca generowanie obrazów przy pomocy monitów tekstowych w systemie Windows to sama przyjemność w tworzeniu grafik. Prosta instalacja, jasne menu oraz duży wybór opcji generowania obrazu to tylko jego podstawowe plusy, bo jest ich znacznie więcej. Dla zainteresowanych uruchomieniem Stable Diffusion UI v2 odsyłamy do naszego artykułu na ten temat, gdzie znajdziecie linki do pobrania Stable Diffusion UI v2 na Windows jak również na system Linuks.

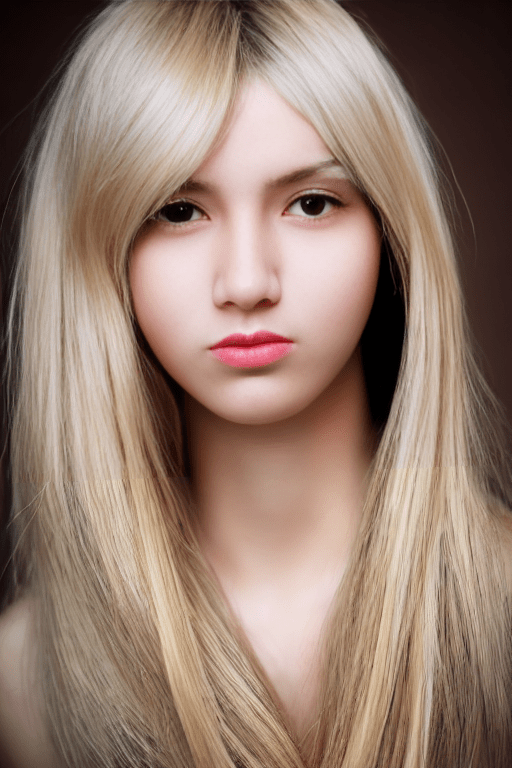

Dziś postaram się Wam podpowiedzieć w jaki sposób generować fotorealistyczne portrety przy pomocy oprogramowania Stable Diffusion UI v2.

Liczba opcji jakie znajdziecie w programie Stable Diffusion UI v2 może każdego zgubić: oświetlenie, style malarskie, kamera, kolory itd.… Jednak wcale nie musimy wybierać dużo tagów i tworzyć skomplikowane opisy, żeby wygenerować piękne zdjęcia portretowe.

Generowanie fotorealistycznych portretów

Na początek musimy pamiętać że opisy należy tworzyć w j. angielskim.

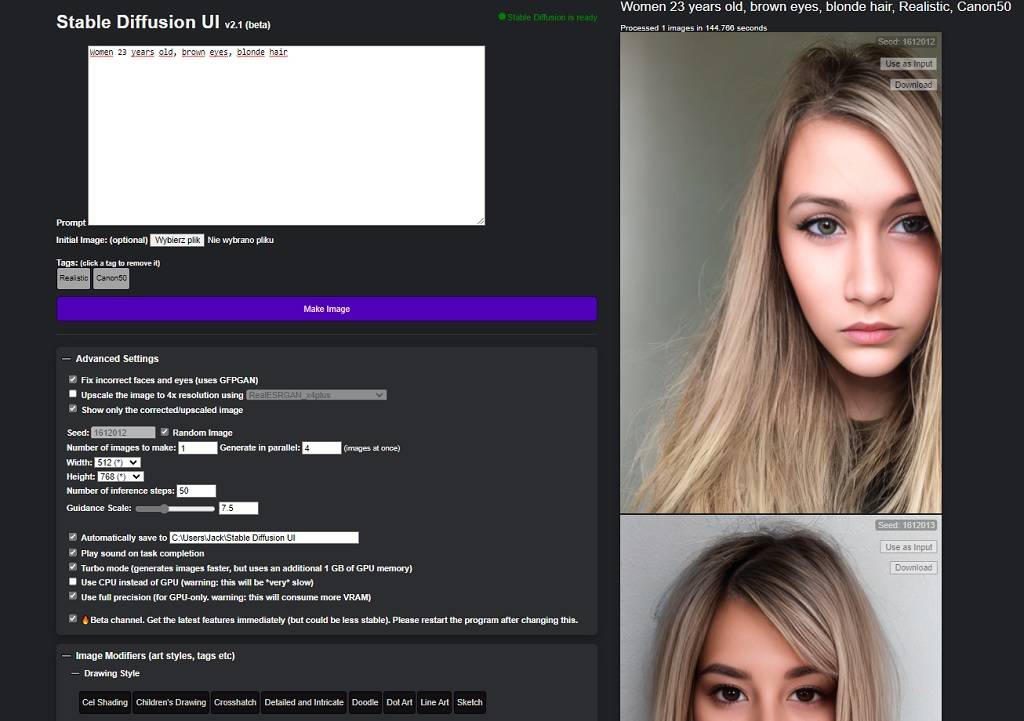

Zaczynamy od uruchomienia oprogramowania w przeglądarce, ukarze się nam po dłuższej chwili rozbudowane menu. Ustawimy w nim tylko tylko kilka opcji.

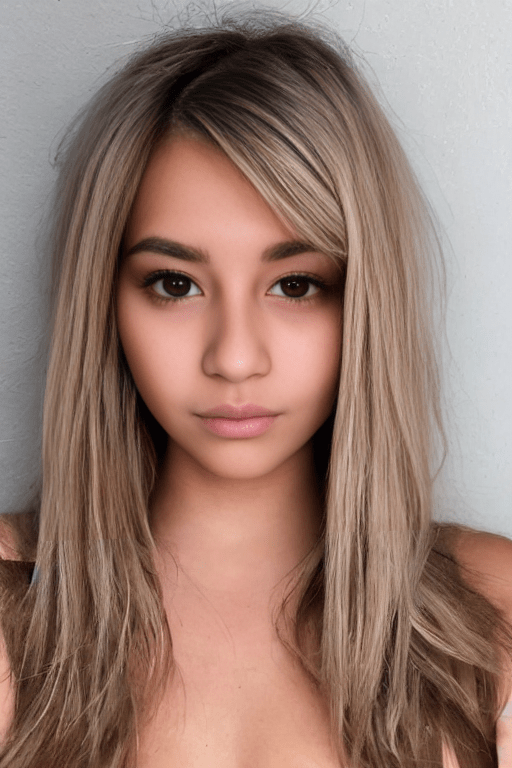

Opis: Women 23 years old, brown eyes, blonde hair

Jak widzicie opis jest krótki i możecie go stworzyć przy użyciu translatora Google jeżeli nie znacie j. angielskiego.

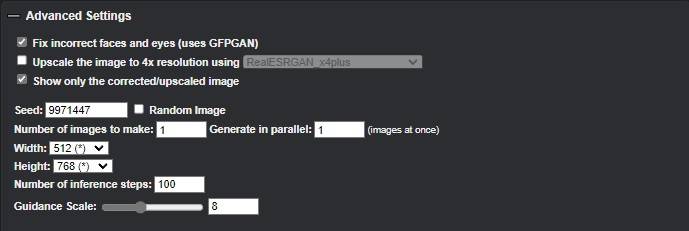

Następnie zaznaczamy opcję: Fix incorrect faces and eyes (uses GFPGAN)

GFPGAN to algorytm który rewelacyjnie poprawia twarz generowanego obrazu, pisaliśmy o nim jakiś czas temu. Jest to świetne wzmocnienie Stable Diffusion przy generowaniu zdjęć ludzi.

Wybieramy teraz liczbę zdjęć, które ma wygenerować nam Stable Diffusion UI v2 /żeby wybrać zdjęcie, nad poprawą którego się później skupimy/. Liczba generowanych zdjęć zależy od waszej karty graficznej a dokładnie od ilości pamięci jaką karta posiada, na karcie RTX 3060 12GB bez problemu program generuje 16 zdjęć jednocześnie.

Pozostały nam tylko tagi do ustawienia. Wybieramy tylko 3 tagi:

Visual Style: Realistic

Camera: Canon50 oraz Portrait

Następnie przycisk „make image” i zaczyna dziać się magia:)

Generowanie potrwa kilka minut w zależności od wydajności waszej karty graficznej.

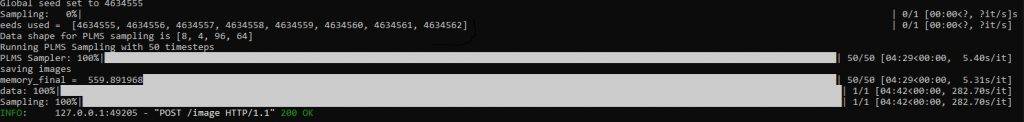

Wybierzemy teraz jedno zdjęcie które Wam się najbardziej spodobało, jeżeli wygenerowaliśmy ich kilka musimy odszukać jego indywidualny numer „Seed„.

Indywidualny numer seed znajdziecie w oknie cmd gdzie możecie obserwować postępy w generowaniu obrazów. Opcja „eeds used” pokazuje listę numerów poszczególnych wygenerowanych zdjęć. Przepisujemy numer wybranego przez nas zdjęcia i wpisujemy go ręcznie na panelu Stable Diffusion UI.

Aktualizacja: w najnowszej wersji Stable Diffusion UI v2 numer seed umieszczony jest na podglądzie każdego wygenerowanego zdjęcia, więc nie ma potrzeby sprawdzania go w oknie cmd.

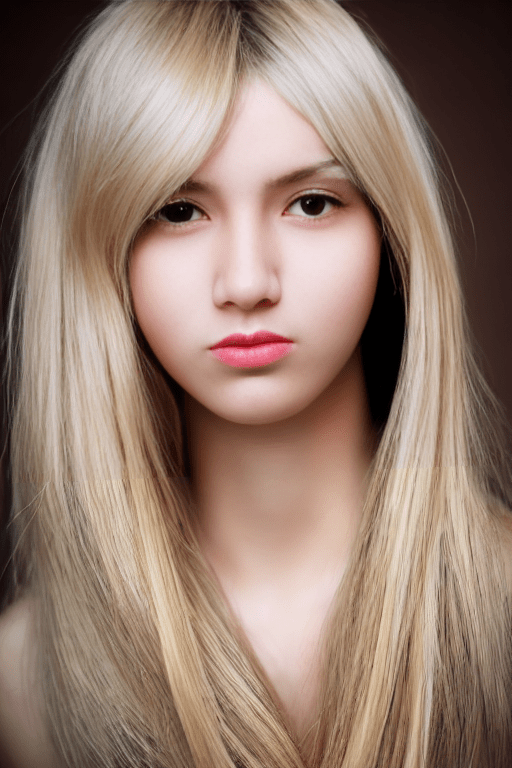

Teraz sprawdźmy co się stanie kiedy program otrzyma więcej danych. Dodamy wzrost i wagę naszej wirtualnej modelki: „Women 23 years old, brown eyes, blonde hair, weight 60, 168 cm tall” Poniżej mamy efekt dodania dwóch dodatkowych tagów. Wydaje się że nasza modelka trochę wyszczuplała.

Możemy jeszcze zwiększyć liczbę kroków „Number of inference steps” czyli wydłużyć czas generowania zdjęcia co powinno teoretycznie przełożyć się na większą szczegółowość zdjęcia. Jednak wydaje mi się, że optymalna liczba kroków to od 100 do maksymalnie 200.

Często jest tak że zdjęcie bardzo nam się podoba, ale ma pewne błędy w obrazie które psują nam cały efekt. Możemy wtedy użyć funkcji „Guidance Scale” i zwiększać jej parametr.

Jakie jeszcze tagi warto wypróbować przy kreowaniu portretów? Sugeruję użyć: Beautiful Lighting oraz Dynamic Lighting z opcji „Color„.

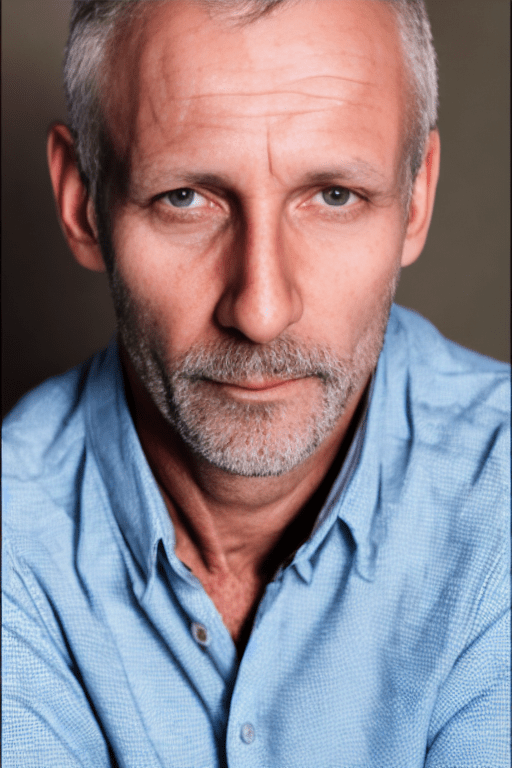

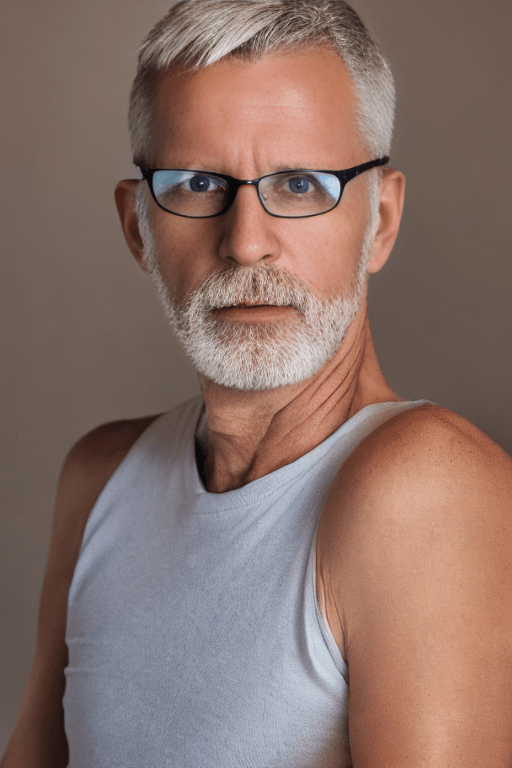

Mam nadzieję że ten artykuł pomoże Wam w pierwszych krokach w programie Stable Diffusion UI v2. Poniżej kilka innych przykładów portretów wykonanych w opisany powyżej sposób.